Inteligencia Artificial en los ADAS: El Salto a la Conducción Predictiva

La inteligencia artificial ha dejado de ser una promesa futura para convertirse en el corazón operativo de los sistemas ADAS actuales. En 2025, los algoritmos de aprendizaje profundo no solo asisten al conductor: anticipan, predicen y deciden en milisegundos. Este cambio fundamental está transformando la naturaleza de la seguridad vehicular, pasando de la reacción a la predicción.

El Cerebro Digital: Cómo la IA Interpreta el Entorno

Los sistemas ADAS modernos funcionan bajo un modelo de tres capas que replica el proceso cognitivo humano pero con velocidad y precisión sobrehumanas: percepción, interpretación y actuación.

Percepción: Los Ojos del Automóvil

La percepción comienza en los sensores: cámaras de múltiples espectros, radares de onda milimétrica, lidar y sensores ultrasónicos recopilan información del entorno a decenas de fotogramas por segundo. Lo crítico es que estos datos sin procesar son casi inútiles por sí solos. Una cámara captura millones de píxeles; un lidar genera nubes masivas de puntos 3D. Sin inteligencia artificial que traduzca estos datos en comprensión, el automóvil sería ciego.

Aquí entran las redes neuronales convolucionales (CNN), específicamente arquitecturas como YOLO (You Only Look Once) y sus variantes avanzadas. YOLO divide la imagen en una cuadrícula y predice en una sola pasada qué objetos están presentes, dónde se encuentran exactamente y con qué confianza. A diferencia de algoritmos más antiguos que examinaban múltiples regiones de la imagen secuencialmente, YOLO procesa la imagen completa de forma simultánea, logrando velocidades de detección en tiempo real superiores a 30 fotogramas por segundo incluso en hardware vehicular estándar.

La última generación, YOLOv9, incorpora mejoras arquitectónicas como CSPnet para planificación eficiente del gradiente y ELAN para optimizar velocidad de inferencia sin sacrificar precisión. El resultado: sistemas capaces de identificar peatones, ciclistas, vehículos, señales de tráfico, obstáculos y marcas de carril con precisiones superiores al 92%.

Interpretación: El Razonamiento Predictivo

La detección de objetos es apenas el primer paso. El verdadero poder de la IA en ADAS radica en la interpretación predictiva: anticipar lo que sucederá en los próximos segundos basándose en patrones históricos y contexto actual.

Cuando un ADAS moderno detecta a un peatón aproximándose a un paso de cebra, no simplemente lo registra. Sus algoritmos de machine learning evalúan simultáneamente:

- La trayectoria del peatón: ¿Se mueve hacia la calzada o alejándose? ¿Con qué velocidad?

- El estado del semáforo y su temporizador predecible

- Las velocidades históricas en esta ubicación específica

- Las condiciones meteorológicas y su impacto en adherencia

- El comportamiento del conductor actual y su patrón de reacción

Este análisis se realiza en menos de 100 milisegundos, permitiendo que el sistema alcance decisiones más anticipadas que las que un conductor humano podría tomar. Tesla estima que sus redes neuronales Deep Learning, entrenadas con datos de millones de kilómetros reales, permiten anticipar escenarios de riesgo entre 0.5 y 2 segundos antes de que se materialicen.

Algoritmos de Predicción de Trayectorias

Un avance crítico en 2025 es el desarrollo de sistemas de predicción de maniobras e intenciones de otros vehículos. Investigaciones académicas como «The PREVENTION Dataset» entrenan redes neuronales convolucionales para clasificar las acciones futuras de conductores circundantes en categorías como «cambio de carril a la izquierda», «cambio de carril a la derecha» o «mantener carril».

Estos sistemas alcanzan tasas de acierto similares o superiores a la capacidad humana de predicción. Lo más relevante: pueden hacer estas predicciones basándose únicamente en datos visuales sin depender de señales de giro explícitas, permitiendo detectar maniobras peligrosas antes de que el conductor las señalice.

Innovaciones más recientes como Traj-LLM llevan esto más lejos, integrando modelos de lenguaje amplios preentrenados (LLMs) con módulos especializados de aprendizaje probabilístico consciente del carril. El resultado es predicción de trayectorias con comprensión contextual casi humana, capaz de razonar sobre escenarios complejos e impredecibles que no aparecieron en los datos de entrenamiento.

Aprendizaje Automático: El Sistema que Nunca Deja de Aprender

Lo que distingue a los ADAS de 2025 de sus predecesores es la capacidad de aprender continuamente de nuevos datos y situaciones. Esto ocurre de dos maneras: en nube y en vehículo.

Aprendizaje en la Nube: Flota Global como Laboratorio

Cada vehículo equipado con ADAS genera terabytes de datos visuales, sensoriales y de contexto diariamente. BYD, por ejemplo, mantiene la mayor base de datos en la nube de vehículos en China, con datos de millones de trayectos en tiempo real. Estos datos se procesan en centros de datos masivos donde se entrenan y refinan modelos de IA compartidos.

El beneficio es multiplicativo: cuando Tesla identifica un escenario nuevo o peligroso en San Francisco, este aprendizaje se propaga a través de actualizaciones OTA (Over-the-Air) a todos los Tesla en el mundo en cuestión de días. Un conductor en Madrid o Múnich se beneficia inmediatamente de decisiones de conducción que otros Tesla ya han tomado exitosamente.

Aprendizaje en Vehículo: Adaptación Personalizada

Simultáneamente, los sistemas ADAS adaptan sus modelos a los patrones específicos de conducción del propietario. Los algoritmos de machine learning detectan preferencias individuales de velocidad, distancia de seguridad, agresividad de frenado y respuesta ante situaciones de estrés vial. Con el tiempo, el automóvil se vuelve más efectivo anticipando las intenciones de su conductor, mejorando la coordinación hombre-máquina.

Este aprendizaje personalizado es especialmente valioso para funciones de asistencia predictiva como el frenado de emergencia automático: el sistema calibra automáticamente su sensibilidad según el contexto, el historial de actuaciones falsas y la validación empírica de su utilidad para ese conductor específico.

Casos Líderes: De la Teoría a la Realidad

Tesla FSD: Redes Neuronales sin LiDAR

Tesla tomó deliberadamente una decisión radical: rechazar el lidar y depender casi exclusivamente de visión computarizada combinada con aprendizaje profundo. Elon Musk ha llamado al lidar «estúpido, caro e innecesario», apostando en su lugar por redes neuronales cada vez más sofisticadas operando en hardware vehicular estándar.

Este enfoque tiene un costo: la conducción autónoma de Tesla requiere reentrenamiento constante con datos de millones de kilómetros reales. Tesla Dojo, la supercomputadora de entrenamiento anunciada en 2021, procesa esta información a escala masiva. En 2025, Tesla espera lanzar su servicio FSD no supervisada (Full Self Driving Unsupervised) globalmente, con pruebas actuales de robotaxi alcanzando 24,000 kilómetros en Austin y San Francisco.

La ventaja competitiva es clara: la arquitectura visual de Tesla, aunque requiere mayor potencia computacional, permite escalabilidad económica sin depender de sensores caros, democratizando la autonomía en el largo plazo.

BYD God’s Eye: IA Multimodal Integrada con DeepSeek

BYD tomó un camino complementario pero igualmente sofisticado. Su sistema «God’s Eye» (Ojo de Dios) integra tres sensores lidar con capacidad de procesamiento de 600 TOPS, combinando percepción redundante con aprendizaje profundo.

Lo notable de BYD es su asociación estratégica anunciada en febrero de 2025 con DeepSeek, la startup china de inteligencia artificial que ganó notoriedad recientemente por desarrollar modelos de lenguaje altamente competitivos a bajo costo. La integración de tecnología DeepSeek permite a God’s Eye:

- Razonamiento contextual más cercano al pensamiento humano en situaciones complejas

- Mejor comprensión de intenciones implícitas en el comportamiento de otros conductores

- Adaptación más rápida a nuevas situaciones nunca vistas en entrenamiento

- Explicabilidad mejorada de decisiones (crítico para regulación y confianza del usuario)

La arquitectura XUANJI de BYD combina una IA en vehículo (para decisiones en tiempo real) con IA conectada a la nube (para aprendizaje continuo y predicción a largo plazo). Este enfoque híbrido equilibra latencia crítica con capacidad de aprendizaje global.

El Impacto en Seguridad: De la Asistencia a la Predicción

Los sistemas ADAS basados en IA están demostrando reducciones medibles en accidentes graves. Según el informe DEKRA «Technology and People» de 2025, los sistemas de IA podrían reducir más del 40% de los accidentes graves cuando se despliegan a escala global.

Esta mejora dramática no proviene únicamente del frenado automático de emergencia o detección de colisiones. El verdadero salto es la anticipación de riesgo: sistemas que alertan al conductor o intervienen preventivamente 0.5 a 2 segundos antes de que se desarrolle una situación peligrosa. En conducción, dos segundos de anticipación pueden significar la diferencia entre una reacción eficaz y una colisión irreversible.

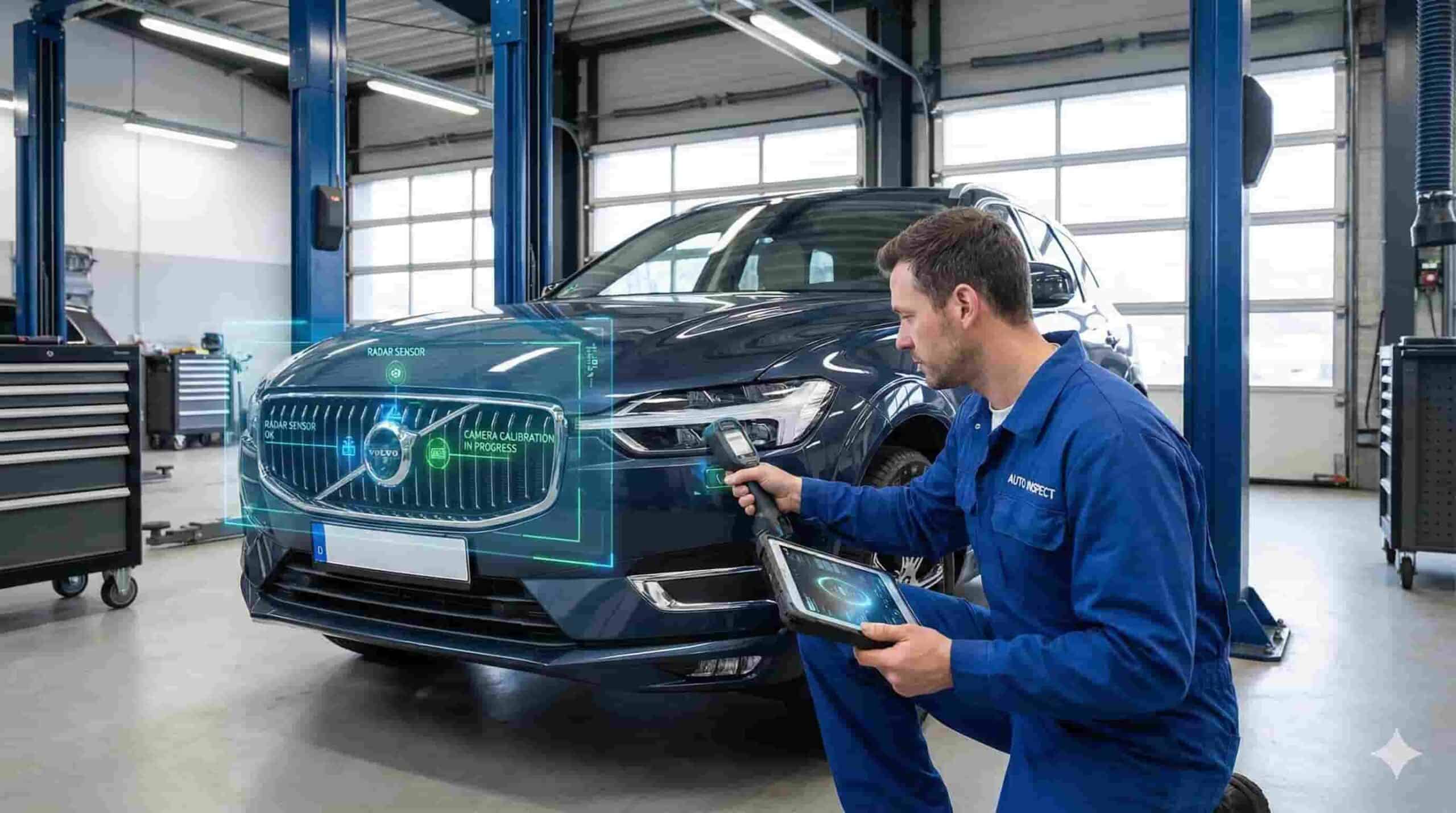

Monitorización del Conductor Impulsada por IA

Los algoritmos de IA también están revolucionando la monitorización de estado del conductor. Las cámaras internas analizan patrones de parpadeo, movimiento de cabeza, enfoque de la mirada y cambios de postura para detectar fatiga, somnolencia, distracción o impairment (consumo de sustancias). Estos sistemas son capaces de identificar signos de deterioro cognitivo antes de que se materialicen en errores de conducción.

Lo más innovador: estos sistemas aprenden a personalizar sus umbrales. El algoritmo identifica patrones normales para este conductor específico y alerta únicamente cuando detecta desviaciones estadísticamente significativas, reduciendo falsas alarmas mientras mantiene precisión en situaciones reales de riesgo.

Límites Actuales y Desafíos de la IA en ADAS

El Problema de la Transferencia: De Simulación a Realidad

A pesar del progreso, la IA en ADAS enfrenta desafíos fundamentales. Los modelos se entrenan típicamente en datasets sintéticos o bajo-representativos de la diversidad real del mundo. Un sistema entrenado primariamente con datos urbanos europeos puede tener tasas de error mucho más altas en autopistas australianas o vías rurales de India.

Este problema de «transferencia de dominio» permanece sin resolver completamente. Los fabricantes invierten significativamente en recopilación global de datos, pero nunca pueden cubrir la combinación infinita de condiciones meteorológicas, infraestructuras viales, patrones de tráfico y comportamientos culturales de conducción.

Robustez ante Adversarios

Investigaciones recientes han demostrado que sistemas de visión computarizada pueden ser engañados por perturbaciones adversariales invisibles al ojo humano: pequeños cambios en píxeles que causan clasificaciones completamente erróneas. Aunque estos ataques son principalmente académicos hoy, la vulnerabilidad teórica es preocupante para sistemas críticos de seguridad.

Explicabilidad: El «Problema de la Caja Negra»

Incluso cuando los algoritmos funcionan correctamente, frecuentemente no podemos explicar su lógica de decisión. Un modelo de red neuronal profunda que alcanza 97% de precisión en detección de objetos es matemáticamente una «caja negra»: sus decisiones emergen de millones de parámetros sin una explicación causal clara.

Esto es problemático para regulación, confianza del consumidor y responsabilidad legal. Si un ADAS falla catastróficamente, reguladores y abogados querrán saber por qué. «La red neuronal lo decidió» no es una respuesta aceptable.

El Futuro: Hacia Autonomía Predictiva Total

Para 2026-2027, los expertos anticipan la convergencia de múltiples tendencias:

- Modelos multimodales mejorados que integren no solo visión sino también datos de otros sensores, mapas dinámicos y comunicación V2X en un razonamiento unificado

- IA explicable que pueda justificar sus decisiones de conducción en términos comprensibles para reguladores y usuarios

- Aprendizaje continuo en tiempo real que permita adaptación instantánea a nuevas situaciones sin requerir actualización global

- Conducción autónoma condicional (Nivel 3) expandida globalmente con sistemas capaces de negociar tráfico urbano complejo bajo supervisión remota

Lo más revolucionario será cuando la IA pase de reaccionar a situaciones de riesgo a prevenirlas activamente. Imagina un futuro donde tu automóvil, observando una acumulación de factores de riesgo (fatiga del conductor + velocidad elevada + lluvia + carretera sinuosa), reduce automáticamente velocidad y sugiere descanso, previniendo un accidente antes de que sea siquiera posible.

El punto crítico: La IA en ADAS no es sustituto del conductor humano. Es amplificador de la seguridad humana. Los sistemas más efectivos serán aquellos que logran el equilibrio: asistencia predictiva continua que respeta el control del conductor, con intervención automática solo cuando el riesgo es crítico.

Conclusión: Una Revolución Silenciosa ya en Marcha

La inteligencia artificial ha dejado de ser una característica publicitaria de lujo para convertirse en el tejido conectivo de la seguridad vehicular moderna. Los algoritmos que operan silenciosamente en cada automóvil equipado con ADAS están, literalmente, salvando vidas hoy.

En 2025, el mercado de ADAS impulsado por IA está valorado en 72,100 millones de dólares, con proyecciones de alcanzar 228,200 millones en 2035. Estos números reflejan una realidad simple: la conducción segura del futuro no dependerá de normas o multas, sino de la capacidad de anticipación de los sistemas inteligentes que nos rodean.

El verdadero cambio es este: hemos transitado de automóviles que reaccionan a lo que sucede, a automóviles que predicen lo que sucederá. Y esta es apenas el comienzo.

Este artículo forma parte de nuestra serie sobre el estado actual de los sistemas ADAS en 2025. Para conocer más sobre la integración de sensores, consulta nuestro próximo artículo sobre Fusión de Sensores y LiDAR. Próximas entregas: V2X y 5G, El Salto al Nivel 3 de Autonomía.